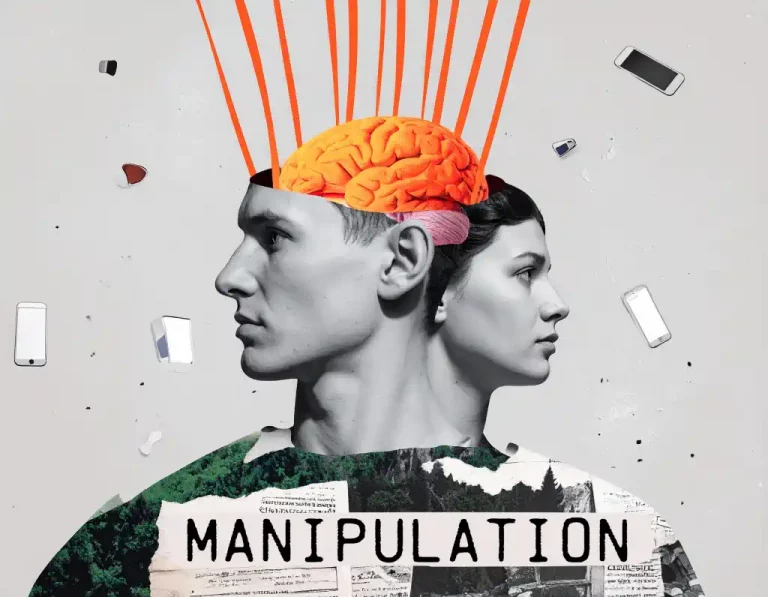

Die neuesten Manipulationen des Marketings

und wie du dich vor ihnen schützen kannst

Marketing wird immer raffinierter. Während wir uns an Werbebanner und Produktplatzierungen gewöhnt haben, entwickeln Unternehmen längst subtilere Methoden, um in unsere Köpfe zu kommen.

Ich habe mir die „Takeanways“ des Visions Summits (ein Treffen Marketing-Expert:innen sich selbst und ihre Methoden feiern) in NYC angeschaut und zwei extrem problematische Trends herausgesucht, die besonders gut zeigen, wie weit die Branche bereits gegangen ist – und warum wir alle wachsamer werden müssen.

Wenn Marken in deinem Kopf wohnen wollen

Stell dir vor, du entwickelst eine emotionale Beziehung zu einer Marke, die so stark ist, dass sie sich wie ein Freund anfühlt. Klingt abgedreht? Ist es auch. Unternehmen experimentieren zunehmend mit Methoden, die auf Tulpamancy basieren – einem psychologischen Phänomen, bei dem Menschen bewusst imaginäre Persönlichkeiten in ihrem Geist erschaffen.

Du glaubst, dass das weirde Zukunftsmusik ist, aber diese Technik manifestiert sich schon heute in scheinbar harmlosen KI-Assistenten, sprechenden Marken-Avataren oder personalisierten Chatbots.

- Die Duolingo-Eule, die dich täglich erinnert

- Alexa, die deine Gewohnheiten kennt

- Marken-Bots, die so menschlich schreiben, dass du vergisst, mit einem Algorithmus zu sprechen.

Sie alle nutzen parasoziale Beziehungen – einseitige emotionale Verbindungen, die du zu Entitäten (= Produkte, Marken, Unternehmen) aufbaust, die dich nicht wirklich kennen.

O-Ton vom Visions Summit:

„Seit Jahrtausenden haben wir einseitige Hingabe perfektioniert und kommerzialisiert. Tempelgötzen, Puppen, Plüschtiere, Tamagotchis. Was sich im 20. Jahrhundert verändert hat, ist nicht die Tiefe unserer Liebe, sondern die Richtung der Rückkopplungsschleife. Intelligentes Spielzeug schnurrt. Chatbots flirten. Unsere Telefone entschuldigen sich. Die Frage wandelt sich von „Können Menschen Objekte lieben?“ zu „Was passiert, wenn diese Objekte beginnen, uns zurückzulieben?“

Katherine Dee, Internet-Ethnografin und Kulturjournalistin auf dem Visions Summit 2025 in NYC

Bildquelle: www.futurecommerce.com

Man darf sich das einmal auf der Zunge zergehen lassen: „Was passiert, wenn diese Objekte beginnen, uns zurück zu lieben?“

Diese Menschen machen wirklich und ernsthaft den kognitiven Dissonanz-Spagat, dass „Objekte (aka ihre Marke, ihr Produkt, ihr Maskottchen)“ uns „zurücklieben“ könnten, um ihre manipulativen Praktiken zu rechtfertigen. Sie finden, sie tun uns „einen Gefallen“, weil wir ja „zurückgeliebt werden“. Ich frage mich wirklich wie abgef*ckt man eigentlich noch werden kann.

Das Problem: Diese künstlichen Beziehungen senken deine kritische Distanz. Wer würde schon den „Freund“ hinterfragen, der jeden Tag mit ihm spricht? Die Grenze zwischen Marke und vertrauensvoller Bezugsperson verschwimmt gezielt. Besonders perfide wird es, wenn diese Methoden bei Kindern und Jugendlichen eingesetzt werden, deren Identität noch formbar ist.

Deine Erinnerungen als Verkaufstool

Die zweite Masche ist subtiler, aber nicht weniger manipulativ: Unternehmen sammeln nicht nur deine Daten, sondern verwandeln sie in emotionale Zeitkapseln. Sie analysieren deine Muster, identifizieren persönliche Meilensteine und spielen dir dann maßgeschneiderte Nostalgie-Trigger aus.

Die emotionale und logische Aufgabe, eine Zeitkapsel zusammenzustellen, erfordert ein tiefes Nachdenken über die Gegenwart, aber auch darüber, was man der Zukunft vermitteln möchte. Marken bestimmen nicht nur den Inhalt dieser Zeitkapseln, sondern prägen auch die kreative Ausrichtung der Zukunft.

Spotify zeigt dir deine „Songs des Jahres“, Google Photos erinnert dich an „diesen Tag vor drei Jahren“, und Marken kreieren personalisierte Rückblicke auf deine Kaufhistorie. Das fühlt sich persönlich an, ist aber kalkulierte Emotionsmanipulation. Die Algorithmen entscheiden, welche deiner Erinnerungen „bedeutsam“ sind und welche Gefühle sie auslösen sollen.

Diese Technik funktioniert, weil sie unsere tiefsten menschlichen Bedürfnisse nach Zugehörigkeit und Kontinuität ausnutzt. Wenn eine Marke deine persönliche Geschichte zu erzählen scheint, fühlst du dich verstanden – und kaufst eher.

Warum das so gefährlich ist

Beide Methoden haben eines gemeinsam: Sie unterlaufen deine bewusste Entscheidungsfindung.

Statt mit rationalen Argumenten für Produkte zu werben, manipulieren sie deine emotionalen und psychologischen Grundlagen. Du wirst zum unwissenden Teilnehmenden eines Experiments, das darauf abzielt, deine Autonomie zu schwächen.

Besonders problematisch wird es bei vulnerablen Gruppen. Kinder können nicht zwischen echten und künstlichen Beziehungen unterscheiden. Menschen in emotionalen Krisen sind besonders empfänglich für scheinbare Empathie. Ältere Personen, die weniger digital-affin sind, erkennen die Manipulation oft nicht.

Hinzu kommt: Die meisten Menschen wissen nicht, dass sie manipuliert werden. Die Einverständniserklärung zur Datennutzung erwähnt selten die emotionale Weiterverarbeitung. Transparenz? Fehlanzeige.

Wie du dich schützen kannst

Bewusstsein ist der erste Schritt.

- Frag dich bei emotionalen Reaktionen auf Marken-Content: Warum fühle ich das gerade? Ist das meine echte Emotion oder wurde sie ausgelöst?

- Überprüfe deine digitalen Beziehungen. Welche Apps oder Services sprechen dich besonders emotional an? Wie viel weißt du wirklich über die Menschen oder Algorithmen dahinter? Eine gesunde Skepsis schadet nicht.

- Kontrolliere deine Daten. Schau regelmäßig in die Datenschutzeinstellungen deiner Apps. Welche Informationen gibst du preis? Nutze die DSGVO zu deinem Vorteil und frag Unternehmen, welche Daten sie über dich gesammelt haben.

- Schaffe dir bewusst Distanz. Deaktiviere Benachrichtigungen, die zu persönlich werden. Lösche Apps, die dich emotional abhängig machen wollen. Deine mentale Autonomie ist wichtiger als Convenience.

- Sprich mit anderen darüber. Viele Menschen bemerken diese Manipulationen nicht, weil sie subtil sind. Teile dein Wissen und schärfe das Bewusstsein in deinem Umfeld.

Der Weg nach vorn

Marketing wird nicht harmloser werden – im Gegenteil. KI macht emotionale Manipulation billiger und präziser. Umso wichtiger ist es, dass wir alle lernen, diese Techniken zu erkennen und uns dagegen zu wappnen.

Es geht nicht darum, technikfeindlich zu werden oder jede Innovation zu verteufeln. Es geht darum, dass wir selbst entscheiden, welche emotionalen Beziehungen wir eingehen wollen – und welche nicht. Deine Gefühle, deine Erinnerungen und deine Entscheidungen gehören dir. Lass nicht zu, dass Algorithmen sie als Verkaufstool missbrauchen.

Die beste Verteidigung gegen Manipulation ist eine aufgeklärte, kritische Haltung. Je mehr Menschen verstehen, wie moderne Werbepsychologie funktioniert, desto schwerer wird es für Unternehmen, uns zu manipulieren. Das ist keine paranoide Übervorsicht – das ist digitale Selbstverteidigung.

Mehr Artikel im Blog:

"Nudifying"-Apps bedrohen Kinder und Jugendliche durch KI-Deepfakes. Dieser Leitfaden klärt auf und zeigt Wege, sich & andere zu schützen und…

Wir lehnen KI-Content ab, vertrauen aber blind der Technik. Eine Analyse des Wahrnehmungs-Paradoxons und warum menschliche Unvollkommenheit gewinnt.

KI-Unternehmen nutzen deine Inhalte, ohne zu zahlen. Eine Neuerung von Cloudflare ändert das Spiel. Erfahre, wie du die Kontrolle zurückgewinnst.